Necesitamos la inteligencia artificial para sobrevivir como especie

Seis expertos reflexionan sobre cómo orientar esta herramienta en nuestro beneficio

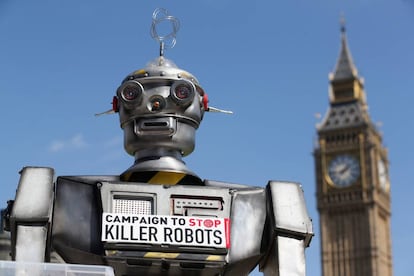

Armas autónomas que ataquen a un objetivo sin necesidad de intervención humana, sistemas de análisis de comportamientos capaces de influir en el voto de la sociedad o vehículos sin conductor que puedan ser hackeados para producir un accidente. La inteligencia artificial además de suponer una gran oportunidad para la humanidad, trae consigo una serie de riesgos. Como dijo en 2017 el físico británico Stephen Hawking, “puede ser lo mejor o lo peor que le suceda a la raza humana”. Los expertos en este sector predicen que habrá quienes intenten hacer un mal uso de esta herramienta. Pero, ¿se debe dejar de usar esta tecnología por ello?

“Necesitamos la inteligencia artificial para sobrevivir como especie”, asegura a EL PAÍS Nuria Oliver, doctora en Inteligencia Artificial por el MIT y miembro de la Real Academia de Ingeniería. Sin ella, “no vamos a poder afrontar muchos de los grandes retos a los que nos enfrentamos como el cambio climático, el envejecimiento de la población y la prevalencia de enfermedades crónicas o la disponibilidad de recursos limitados”.

Más de 8.000 científicos especializados en áreas tecnológicas —como el fundador de Tesla, Elon Musk, o el cofundador de Apple Steve Wozniak— han firmado una carta abierta publicada en 2015 que alerta de los peligros de la inteligencia artificial. Debido a su gran potencial, los expertos sostienen que es importante investigar cómo aprovechar sus beneficios y evitar los riesgos potenciales. Por ello, la Comisión Europea ha nombrado este año un Comité de Expertos de Alto Nivel en Inteligencia Artificial, con el fin de estudiar las implicaciones éticas, legales y sociales de esta herramienta.

“El peligro de la inteligencia artificial no es la singularidad tecnológica debida a la existencia de unas hipotéticas superinteligencias artificiales. Los verdaderos problemas ya están aquí”, afirma Ramón López de Mántaras. El director del Instituto de Investigación en Inteligencia Artificial del CSIC sostiene que estos riesgos tienen que ver con la privacidad, la autonomía, la excesiva confianza acerca de las capacidades de las máquinas, el sesgo de los algoritmos de aprendizaje y la imposibilidad para rendir cuentas y justificar sus decisiones en un lenguaje comprensible para las personas.

Sonia Pacheco, directora del congreso Digital Business World Congress, distingue entre un mal uso de la inteligencia artificial “no intencionado” y el mal uso “con intencionalidad”. El primero puede ocurrir cuando un algoritmo es entrenado con datos sesgados y condicionados por nuestros conocimientos y prejuicios. Por ejemplo, Amazon empezó a desarrollar en 2014 una inteligencia artificial de reclutamiento que, basándose en los archivos de los últimos 10 años de la compañía, aprendió que los hombres eran preferibles y empezó a discriminar a las mujeres.

Dilemas éticos

“Las decisiones algorítmicas basadas en datos tienen el potencial de mejorar nuestra toma de decisiones”, sostiene Oliver. Pero cuando estas decisiones afectan a miles o millones de personas, “surgen dilemas éticos importantes”: “¿Cómo podemos garantizar que dichas decisiones y actuaciones no tienen consecuencias negativas para las personas? ¿Quién es responsable de dichas decisiones? ¿Qué sucederá cuando un algoritmo nos conozca a cada uno de nosotros mejor que nosotros mismos y pueda aprovechar dicho conocimiento para manipular de manera subliminal nuestro comportamiento?”.

Un mal uso de la inteligencia artificial “con intencionalidad” podría traer consigo riesgos físicos, políticos o de seguridad, según Pacheco. Por ejemplo, un coche autónomo podría ser hackeado y estrellado o usado como un arma, las fake news pueden “llenar de ruido las redes sociales con el objetivo de manipular de manera dirigida a grupos de usuarios seleccionados” y “sistemas maliciosos podrían replicar nuestra voz generando información falsa o generar imágenes de nosotros que fueran irreales gracias a técnicas de regeneración de imagen”.

El fundador y consejero delegado de Amazon, Jeff Bezos, afirmó el pasado abril en el Foro sobre Liderazgo del Centro Presidencial George W. Bush que es “mucho más probable que la inteligencia artificial nos ayude”. Pero reconoció los peligros que puede conllevar: “Las armas autónomas son extremadamente aterradoras”.

El mayor riesgo, según Oliver, “no está en robots físicos sino en sistemas de software de gran escala que pueden afectar a millones de personas en muy poco tiempo”. “Para minimizar el riesgo de que estos sistemas puedan ser hackeados, es fundamental tomar medidas de seguridad, fiabilidad, reproducibilidad, prudencia y veracidad”, afirma la doctora en Inteligencia Artificial por el MIT.

El papel de las compañías tecnológicas

Para Francesca Rossi, directora de Ética en Inteligencia Artificial de IBM, es importante que las compañías tecnológicas apuesten por un desarrollo de esta herramienta con el propósito de aumentar la inteligencia humana y no de reemplazarla. También considera fundamental que exista un diálogo constructivo en el que participen “desde aquellos que se encuentran en la primera línea de la investigación en inteligencia artificial hasta aquellos que representan a los sectores más vulnerables de la sociedad”. Precisamente Rossi forma parte del Comité de Expertos de Alto Nivel en Inteligencia Artificial de la Comisión Europea, que no solo está formado por expertos del ámbito de la tecnología, “sino que se extiende a filósofos, psicólogos, sociólogos y economistas”.

La inteligencia artificial es transversal y puede aplicarse en diferentes campos: desde la biología, la física, la medicina o la química, hasta la educación, los sistemas de producción, la logística y el transporte. Todos los expertos consultados coinciden en que no hay que dejar de utilizar esta herramienta. “Es una cuestión de usarla adecuadamente y poner los controles necesarios para evitar su uso con fines perversos”, afirma Jose María Lucía, socio responsable del Centro de Inteligencia Artificial y Análisis de Datos de EY Wavespace. Para detectar un problema y poner en marcha cualquier solución hace falta dar respuesta a algunas preguntas: “¿Cómo vamos a detectar si algo está saliéndose de los normal?¿Qué hay que hacer si eso ocurre?”. Lucía explica por ejemplo que “ha habido varios casos en el mundo bursátil donde los algoritmos de inversión ante escenarios inesperados han acabado creando el caos”.

Algunas empresas tecnológicas ya han establecido principios básicos para desarrollar la inteligencia artificial de forma ética. David Carmona, director general de Desarrollo de Negocio en Inteligencia Artificial de Microsoft Corporation, explica que su compañía se basa en seis principios básicos: “Ecuanimidad, para asegurarnos de que los algoritmos no tengan sesgos; fiabilidad, para garantizar esa confianza tecnológica; privacidad; transparencia sobre el uso de datos y funcionamiento; inclusión de todas las personas y responsabilidad de la empresa que está detrás de esos procesos”.

El hecho de que la inteligencia artificial exista no quiere decir que necesariamente se vaya a hacer un mal uso de ella, según subrayan los expertos consultados. “De la misma manera que hay códigos éticos consensuados prácticamente a nivel internacional en biomedicina y en otros ámbitos de la investigación científica, se deben asentar unas bases: un código de conducta, unos criterios éticos y unas normas y una estructura regulatoria que impidan que se realice un mal uso”, concluye Pacheco.