Esto que ves no es Tom Cruise, sino el producto de una tecnología tan increíble como inquietante

Se llama DeepFake y no es nueva: ya habíamos visto ejemplos con Barack Obama o Nancy Pelosi. Pero este nuevo vídeo lo perfecciona de tal manera que su efecto asombra y horroriza a partes iguales

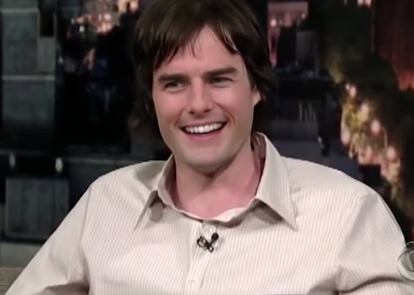

Este extracto de una entrevista con el actor Bill Hader no es nuevo. Tiene, de hecho, once años. Pertenece a una entrevista que concedió a David Letterman en 2008 para promocionar Thunder Tropic: una guerra muy perra (Ben Stiller, 2008) y en él Hader describe cómo fue sentarse en la mesa de lectura de guion con estrellas como Ben Stiller, Tom Cruise o Robert Downey Jr.

Nadie sabe quién se esconde tras el mote 'ctrl shift face'. Pese a que concedió una entrevista, no quiso en ella dar detalles sobre su identidad salvo que tenía 31 años, era esloveno (pero no vive allí) y trabaja en el campo de los gráficos digitales

En la entrevista original el actor explicaba su interactuación con Tom Cruise, del que él era muy admirador, y lo imitaba con mucha pericia, provocando la risa entre el público presente en plató. Pero en este extracto que ahora nos ocupa algo cambia y lo hace de manera tan limpia, perfecta y casi alquímica que la reacción que provoca en el espectador es de asombro, delirio y terror a la vez. Esta vez, cada vez que Bill Hader imita a Tom Cruise, o sea, cada vez que pone su voz para remarcar algo que él le dijo durante su conversación, Hader se convierte en Tom Cruise.

Observen. No hace falta entender inglés, la magia es meramente visual: ocurre en los minutos 0:54, 1:00, 1:23, 1:38 y 1:45. De repente otro actor cómico, Seth Rogen, aparece en el hilo de la conversación y Hader se convierte de facto en él en el minuto 1:54. Volverá a convertirse, en los tres minutos escasos que dura el extracto, en Tom Cruise tres veces más.

El sorprendente vídeo en el que el actor Bill Hader se convierte, gracias a la tecnología, en Tom Cruise de forma repentina.

El efecto es impresionante. No solo por la perfección (¡es Tom Cruise!), sino por la forma suave e imperceptible en que un rostro pasa a ser otro. El vídeo acumula en pocos días más de dos millones de visualizaciones y los comentarios reflejan muy bien el asombro de un público que parecía curado de espantos con los adelantos de la tecnología. Se pueden leer cosas como: "Tengo miedo, ¡Jesús! El mundo va a arder con esta tecnología"; "esta es, sin duda, la mierda más divertida y terrorífica que he visto en mucho tiempo" o "¿alguien más está preocupado por cómo esto va a ser utilizado como arma para beneficios políticos?".

Este último comentario da en la diana: es obvio que la posibilidad de crear vídeos donde cualquier persona hace y dice cosas que no ha dicho ni hecho en la realidad puede cambiar las reglas del juego de una campaña política. Ya hemos visto esta tecnología usada con esos fines. La pasada primavera por Facebook corrió como la pólvora un vídeo en el que Nancy Pelosi (presidenta de la Cámara de Representantes y una de las rivales más visibles de Trump en las filas demócratas) aparecía supuestamente borracha. Es un ejemplo de deepfake, el nombre que recibe este tipo de trucaje.

En el cuarto episodio de la visionaria miniserie británica 'Years and years' aparecen vídeos de los candidatos al gobierno británico diciendo cosas que ellos no han dicho. Son ejemplos de la tecnología 'deepfake' aplicados a la política

Y en el cuarto episodio de la visionaria miniserie británica Years and years aparecen vídeos de los candidatos al gobierno británico diciendo cosas que ellos no han dicho. El episodio narra muy bien el peligro implícito en todo esto incluso aunque sepamos que esos vídeos no son reales: la ultraderechista Vivian Rook (Emma Thompson), la única que no aparece en esos vídeos-montaje, admite que pueden ser falsos, sí, pero que esos políticos seguramente dicen esas cosas. El público sabe que se enfrenta a una mentira, pero la imagen del político al que iban a votar diciendo cosas horribles, aunque sean generadas digitalmente, cala hondo en ellos. En la ficción, Vivian Rook gana y se convierte en primera ministra.

El creador de este vídeo, el artista visual con el seudónimo ctrl shift face, tiene muchos otros vídeos en su perfil de YouTube con esta misma temática. En ellos convierte a Bruce Lee en Keanu Reeves o a Jim Carrey en Jack Nicholson. Sin embargo, este se ha convertido en su obra más popular. Nadie sabe quién se esconde tras el mote ctrl shift face. Pese a que concedió una entrevista a la página Digital Trends, no quiso en ella dar detalles sobre su identidad. Eso sí, reveló que tenía 31 años, era esloveno (pero no vive allí) y trabaja en el campo de los gráficos digitales.

La primera vez que oímos hablar de esta tecnología fue en un reportaje de Motherboard (la parte de noticias digitales de la plataforma Vice) en diciembre de 2017. Y, por supuesto, lo primero que los aprendices de Internet y amateurs de esta técnica hicieron con ella fue... porno. Porno con sus celebridades favoritas, porno con amigos y vecinos. Ese es otro de los grandes peligros: la posibilidad de ver una escena de sexo explícito con los cuerpos de dos intérpretes de cine para adultos y los rostros de dos estrellas de cine, políticos, figuras culturales o, mucho peor todavía, nuestros padres.

Barack Obama, Jordan Peele y la web Buzzfeed ya unieron esfuerzos en abril de 2018 para alertar a la población sobre los vídeos 'deepfake'.

La preocupación ya era suficientemente alta en abril de 2018 como para que Jordan Peele (humorista y premiado director de las cinta de terror Déjame salir y Us) y la plataforma Buzzfeed crearan el siguiente vídeo, en el que Obama se dirigía al público alertando sobre las fake news (noticias falsas) y vídeos manipulados... para demostrarse a la mitad que, efectivamente, aquel no era Obama sino un vídeo perfectamente manipulado.

En 2020 hay elecciones presidenciales en Estados Unidos, unas de las más decisivas de la historia, en la que el país deberá decidir si revalida a Donald Trump o da oportunidad a un nuevo camino. Será el momento de saber si las fake news van un poco más allá y los vídeos deepfake, con los candidatos diciendo todo tipo de barbaridades que beneficien al contrario, se convierten esta vez en la norma. Y también de comprobar si esos efectos especiales impresionantes que alucinaron al mundo, por ejemplo, en el vídeo de Black or White de Michael Jackson, dejan de estar en manos de unos cuantos ejecutivos adinerados de Hollywood y pasan a ser posibles para cualquiera con un teléfono móvil y unos cuantos conocimientos.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.