Google aprende los géneros

El servicio propone una doble versión femenina y masculina para traducir en algunos idiomas palabras neutrales en inglés

El lenguaje humano puede reflejar sesgos de género. La inteligencia artificial también. Google admite ser consciente de que los algoritmos pueden replicar discriminaciones tras asimilar y reelaborar datos procedentes del mundo real. Y por eso asegura que trabaja para reducir estos defectos a la hora de desarrollar y mejorar servicios como su traductor automático.

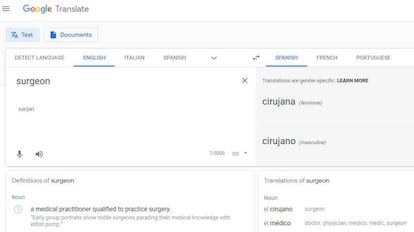

La última novedad de la compañía en este sentido es la implementación de una doble versión femenina y masculina para traducir en algunos idiomas que prevén distinciones por género palabras neutrales en inglés. Así, por ejemplo, si se introduce el sustantivo surgeon en el apartado destinado a la expresión que se quiere traducir, el resultado en castellano que devuelve la herramienta será tanto cirujana como cirujano.

“El traductor de Google aprende de cientos de millones de ejemplos ya traducidos en la red”, asegura en un comunicado publicado este jueves James Kuczmasrki, product manager del servicio. “Por eso, el modelo replicaba sin querer sesgos de género que ya existían a la hora de producir una traducción”, agrega.

Kuczmarski explica que el traductor antes generaba una sola traducción por cada petición, pese a que pudiera existir tanto una versión femenina como masculina. “Por ejemplo, habría proporcionado una traducción masculina para palabras como doctor [doctor, doctora] y femenina para palabras como nurse [enfermero, enfermera]”, detalla el directivo de Google.

Opciones disponibles

De momento, la herramienta genera dobles traducciones de adjetivos, sustantivos y pronombres ingleses sin género en español, francés, italiano y portugués. Así, por ejemplo, para el pronombre personal they, en castellano aparecerán como sugerencias tanto ellas como ellos. Además, el servicio funciona también para traducir breves frases del turco (idioma sin géneros) al inglés. Si se compone la expresión o bir doktor, en inglés se genera la versión masculina he is a doctor [él es un doctor] y la femenina she is a doctor [ella es una doctora].

To reduce gender bias in #GoogleTranslate, we're providing feminine and masculine translations for queries that include gender neutral words → https://t.co/N6yQhSHYWB pic.twitter.com/VVnZeE7GFD

— Google (@Google) December 6, 2018

Google muestra la distinción por género en la versión web de la herramienta disponible para los navegadores Chrome y Firefox. La nueva funcionalidad todavía no es operativa en la aplicación para dispositivos móviles. “Tenemos programado para el futuro extender a más idiomas las traducciones específicas por género. También queremos lanzarlas en la aplicación para los sistemas operativos iOS y Android”, asegura Kuczmasrki.

El orden de visualización de las dos versiones depende de la etiqueta que marca el género según en qué idioma se utilice el traductor (en español, la versión femenina aparece antes que la masculina porque la “f” precede la “m” en el alfabeto). Para idiomas “sin alfabeto”, agrega Google, “las traducciones que distinguen por género se muestran en el orden de indexación estándar de cada idioma”.

La herramienta es abierta a las contribuciones de los usuarios. Los titulares de una cuenta Google pueden acceder a la comunidad de los traductores, elegir los idiomas en los que quieren trabajar y sugerir nuevas traducciones o correcciones de traducciones ya existentes. La compañía recuerda de que no es posible agregar traducciones con distinción por género para los idiomas que todavía no las tienen previstas.

Esfuerzos para evitar sesgos

Kuczmasrki afirma que otros retos en los que se está trabajando son implementar la distinción por géneros en las sugerencias automáticas para completar una búsqueda que se realiza y “cómo afrontar la cuestión del género no binario en las traducciones”.

No es la primera vez que la compañía se enfrenta al problema de evitar sesgos de género en los servicios que ofrece. Según reportó Reuters a finales de noviembre, Google decidió bloquear la sugerencia de pronombres marcados por el género, como him [a él] y her [a ella], en el nuevo sistema Smart Compose, herramienta que sugiere opciones para completar las frases en los correos electrónicos actualmente disponible para el inglés.

La compañía detectó que la herramienta generaba sugerencias sesgadas y buscó distintas maneras para evitar que ocurriera, pero al final tuvo que rendirse. “La única técnica fiable ha sido ser conservativos”, declaró Prabhakar Raghavan, uno de los desarrolladores.