Las redes sobreviven a las elecciones de 2020, pero sus problemas no desaparecen

Facebook y Twitter, sobre todo, han logrado evitar de momento las acusaciones de contribuir a la desinformación electoral

La elección de Donald Trump en 2016 marcó el fin de una era para las redes sociales. La era de la ingenuidad se había terminado: la desinformación, la influencia rusa, las cuentas falsas, el discurso de odio emergieron a la vez y crearon una crisis sin precedentes en Silicon Valley. Las elecciones presidenciales de 2020 iban a ser un nuevo examen. Las redes llevaban años preparándose a conciencia. De momento, han evitado el protagonismo que tuvieron hace cuatro años con muchas más dedicación: etiquetar tuits engañosos y suspender grupos multitudinarios que incitaban a la violencia han sido los dos grandes ejemplos. Era quizá el objetivo principal. Pero las preguntas sobre cómo será su futuro después de superar esta prueba no son fáciles de responder.

Las acciones que han tomado las redes desde la campaña electoral podrían resumirse en una: ponerle riendas y un jinete al caballo desbocado. Facebook, Twitter, Youtube funcionan básicamente de manera automática: lo que vemos y lo que nos recomiendan dependen de algoritmos, que son simplemente programas que escogen contenido según criterios preestablecidos. El gran cambio entre 2016 y 2020 es la aparición del factor humano y de las riendas. Es decir, del control y las normas.

Facebook prohibió anuncios políticos nuevos en la semana anterior a las elecciones y, de momento, también después. Twitter los prohibió completamente, antes y después. Google también los ha suspendido después de las elecciones. Facebook y Twitter acompañan montones de tuits con etiquetas o cortinillas que esconden el contenido para advertir que el escrutinio sigue en marcha o que ese contenido es engañoso: entre ellos, los más notorios, varios del presidente Donald Trump, en los que denunciaba un supuesto fraude sin tener pruebas. Otras cuentas menos conocidas, como la de la nueva congresista Marjorie Greene en Twitter, parecían un reguero de advertencias de desinformación tras las elecciones:

MORE CENSORSHIP!

— Marjorie Taylor Greene 🇺🇸 (@mtgreenee) November 5, 2020

The Silicon Valley Cartel will face the music. Soon! https://t.co/1VMQMii9Ff

Facebook suspendió el grupo Stop the Steal (Stop al Robo) que alcanzó más de 320.000 usuarios en 24 horas. La compañía lo achacó a las “medidas excepcionales” que está tomando tras las elecciones. Y optó por evitarse problemas de raíz cerrando un grupo que podía convertirse en foco de conspiraciones y llamadas a la violencia. Un día después se supo que entre los administradores había dos operativos de Stephen Bannon, exjefe de gabinete de Trump y suspendido a su vez de Twitter por haber pedido poner la “cabeza en una pica” de dos altos cargos de la administración.

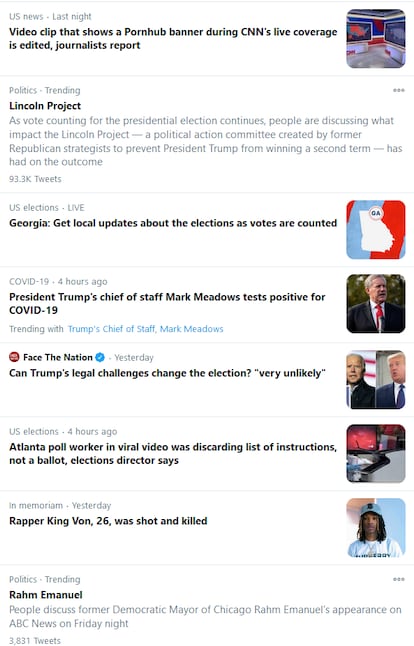

Además de etiquetar mensajes engañosos, Twitter ha cambiado también el modo en que se ven las tendencias (los temas más comentados) en su página. Eso da más contexto y hace claramente más difícil colar teorías infundadas con una campaña organizada de tuits. Así por ejemplo se veían este sábado las tendencias en EE UU: titulares o explicaciones completas con su contexto.

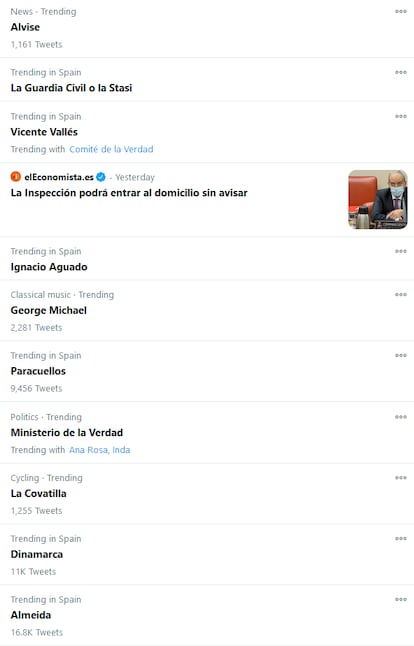

La diferencia con España, por ejemplo, era abrumadora: aquí siguen apareciendo palabras sueltas que pueden significar cualquier cosa. La falta de contexto es claramente una provocación al usuario para clicar.

Youtube, propiedad de la empresa madre de Google, optó por una vía intermedia. Suprimió los directos que emitían información falsa durante la noche electoral, pero luego ha dejado colgados vídeos con cientos de miles de visualizaciones donde dicen que “Trump ha ganado”. Su razonamiento se escuda en sus políticas comunitarias: ese contenido no engaña a los posibles votantes porque las elecciones ya han pasado. Youtube es la que menos restricciones ha puesto a la circulación de posibles noticias falsas ha puesto entre las grandes redes.

A preguntas de EL PAÍS, tanto Facebook como Twitter explican cómo una mezcla de inteligencia artificial y equipos humanos han llevado a sostener el caudal de desinformación que podía haber desbordado en cualquier momento. Y aún puede hacerlo. El desafío era distinguir qué mensajes son los más peligrosos o potencialmente virales, no solo para marcarlos, sino también para reducir su distribución viral. En términos técnicos es lo que se conoce como fricción: cuanto más clics se añaden al proceso de retuitear o compartir, menos viraliza un contenido.

Facebook destaca que tiene a más de 35.000 personas vigilando todos los mensajes que merecen atención, además de los célebres fact-checkers asociados. Es un salto enorme para aquella red social que presumía de querer conectar a todos los humanos para hacer un mundo mejor, tal y como decía Mark Zuckerberg hace unos años. Twitter también combina automatización y humanos para ver qué mensajes son los que requieren atención primero y deben moderar.

Si estas elecciones acaban siendo un hito sobre cómo moderar un acontecimiento potencialmente explosivo, será razonable preguntar en el futuro a las redes sociales por qué vuelven soltar la riendas al caballo salvaje y desbocado cuando no haya un acontecimiento parecido: ¿por qué elecciones en otros países o debates sobre cuestiones delicadas no merecen este nivel de control?

La cuestión está, como siempre, en dónde poner los límites. Ahora los partidarios de Trump gritan “censura” y amenazan con impulsar una legislación que complique la vida a las grandes plataformas. En el futuro, pueden ser otros los que lo exijan. En el fondo, las redes estarán siempre bailando entre varias aguas. Tienen una responsabilidad muy limitada de lo que se publica en ellas porque, a diferencia de los periódicos, son teóricamente neutrales. Pero es inevitable que en algunos momentos, se mojen. Entonces alguien pedirá una regulación más estricta. Aunque las elecciones de 2020 pasen con un aceptable nivel de éxito, 2016 seguirá siendo el año en que su vida cambió para siempre.

Puedes seguir a EL PAÍS TECNOLOGÍA RETINA en Facebook, Twitter, Instagram o suscribirte aquí a nuestra Newsletter.