Elon Musk encabeza una petición a la ONU para prohibir los ‘robots soldado’

116 expertos en inteligencia artificial y robótica reclaman al organismo que impida el uso de armas autónomas

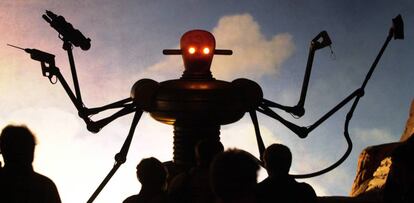

En Terminator, la popular película de James Cameron, el rebelde John Connor se enfrentaba a un ejército de robots asesinos que se hacía con el control del planeta. Aquella situación apocalíptica encajaba perfectamente en el guion de una película de ciencia ficción, pero nadie realmente pensó que podría plantearse en un futuro. Sin embargo, para un plantel de expertos y líderes empresariales de todo el mundo, es una posibilidad muy real: 116 especialistas en robótica e inteligencia artificial han redactado una carta dirigida a Naciones Unidas, en la que solicitan la prohibición del desarrollo de robots dedicados a la guerra. El documento cuenta con la firma, entre otros, de Elon Musk —fundador de Tesla y SpaceX— quien ya alertó hace un mes sobre los peligros para la civilización de la inteligencia artificial. Otro de los firmantes es Mustafa Suleyman, cofundador de la compañía de inteligencia artificial DeepMind, propiedad de Google.

La carta se ha hecho pública durante la apertura del Congreso Internacional de Inteligencia Artificial (IJCAI, por sus siglas en inglés), que arrancó este lunes en Melbourne (Australia). "Una vez desarrolladas [las armas autónomas], permitirán que conflictos armados se libren a una escala mayor que nunca, y a escalas de tiempo más rápidas de lo que los humanos pueden comprender. Estos pueden ser armas de terror, armas que los déspotas y los terroristas usan contra poblaciones inocentes, y armas hackeadas para comportarse de manera indeseable. No tenemos mucho tiempo para actuar. Cuando se abra la caja de Pandora, será difícil de cerrar", reza en su último párrafo.

Los expertos advierten en la misiva de la posibilidad de una “tercera revolución bélica” con la inminente llegada de robots y equipos no tripulados que podrían elevar las guerras a enfrentamientos con consecuencias imprevisibles. En este sentido, los firmantes advierten de que la veloz evolución de la inteligencia artificial podría lograr que el desarrollo de armas autónomas llegue en unos pocos años, y no en décadas, como se estimaba con anterioridad. "No tenemos demasiado tiempo para actuar. Una vez que esta caja de Pandora esté abierta, será difícil cerrarla", advierten los expertos a la ONU, que celebrará este viernes una reunión para debatir sobre los peligros de las armas autónomas.

No tenemos demasiado tiempo para actuar. Una vez que esta caja de Pandora esté abierta, será difícil cerrarla

El uso bélico de la inteligencia artificial lleva tres años generando un intenso debate en las Naciones Unidas que va más allá de la ciencia ficción, que se centra en las implicaciones jurídicas y los riesgos para los civiles inocentes en las zonas de conflicto. La idea de que en un futuro no muy lejano se pierda la compasión y el juicio humano a la hora de ejecutar un ataque preocupa a las delegaciones. Actualmente hay una veintena de países que reclaman su prohibición. "Hoy, la posible pérdida de vidas humanas es un elemento disuasorio para la iniciación de conflictos y la escalada bélica, pero cuando las víctimas potenciales fueran robots, aumentaría dramáticamente la posibilidad de enfrentamiento", aseguró la experta Mary-Anne Williams, de la Universidad de Sídney, a AFP.

En el seno del organismo existe, de hecho, un consenso favorable a que se formalice un proceso que sirva para discutir sobre los temores asociados a estas tecnologías. Pero en lugar de discutir la posibilidad de adoptar una convención internacional que imponga un mayor control, las grandes potencias se inclinan en este momento más por compartir buenas prácticas y elevar la transparencia.

Estados Unidos, Rusia, China, Francia, Reino Unido, Israel y Corea del Sur son los países más avanzados en el desarrollo de sistemas de defensa autónomos. Las ONG, como Human Rights Watch, consideran sin embargo que es un imperativo moral que se marque una línea roja, para así mantener el control humano en las decisiones sobre la identificación de objetivos y el uso último de la fuerza.

La conferencia celebrada a final de 2016 para la revisión del tratado que regula el uso de armas convencionales ya dio un primer paso para regular el uso bélico de la inteligencia artificial, al establecer un grupo de expertos que debata en serio sobre estos sistemas. Los diplomáticos en la ONU coinciden que las convenciones actuales tienen muchas lagunas sobre el desarrollo y uso de estas armas. Otra cosa es que eso derive en la negociación de un instrumento legal.

Lo que temen los expertos es un ejército de robots capaces de comenzar a un enfrentamiento bélico a gran escala en unos pocos minutos, y capaces de tomar decisiones sobre el terreno sin necesidad de recibir órdenes. Parte de lo que podría llegar se está probando ya en los principales ejércitos del mundo, donde drones (aeronaves no tripuladas) sobrevuelan ya el terreno enemigo y pueden equipar armamento letal. La armada estadounidense, por ejemplo, contará en breve en su flota con el buque autónomo Sea Hunter, una nave no tripulada con un gran alcance que podrá ser empleada para llevar a cabo ataques a distancia eliminando el riesgo de bajas propias. Un barco de guerra con mando a distancia, por simplificar el escenario.

Este grupo de expertos quiere adelantarse a los acontecimientos y lograr que el organismo internacional prohíba de antemano el desarrollo de estos robots o instrumentos de guerra autónomos, de la misma manera que se prohibió en su día el uso de armas químicas en los enfrentamientos bélicos o con el láser.

No es la primera vez que los especialistas de esta conferencia lanzan una advertencia sobre los peligros de la inteligencia artificial. Elon Musk ya firmó en julio de 2015 una carta similar en la que expresaba su preocupación por el desarrollo de los robots asesinos y pedía a la ONU que tomara cartas en el asunto, imponiendo un veto internacional. La petición fue suscrita también por Steve Wozniak, cofundador de Apple, y el científico Stephen Hawking.