Cómo los ordenadores colorean de forma creíble viejas fotos en blanco y negro

Una web permite probar la tecnología desarrollada por investigadores de Berkeley

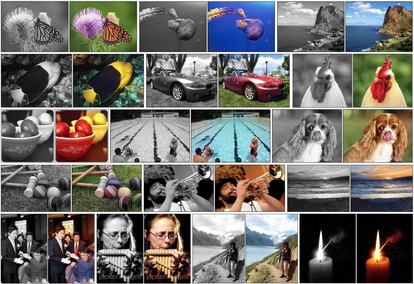

Los ordenadores pueden reconocer qué objeto o quién es la persona que aparece en una fotografía. Saber con más o menos acierto qué hay en la escena captada y qué está sucediendo en ella; si una persona ríe o si llora o si lo que se ve en ella es un paisaje, un animal o un plato de comida. Incluso pueden determinar dónde fue tomada una imagen sin datos GPS, por su contenido.

Los ordenadores pueden comparar cualquier fotografía nueva con todas las demás ya conocidas y determinar qué hay en ella

Los ordenadores han aprendido todo eso porque se lo hemos enseñado a lo largo del tiempo, al guardar en ellos millones de fotografías etiquetadas, descritas y clasificadas. Utilizando programas y sistemas de aprendizaje máquina, o aprendizaje automático, los ordenadores pueden comparar cualquier fotografía nueva con todas las demás fotografías ya conocidas y determinar qué hay en ella.

El mismo principio de aprendizaje máquina es también aplicable al color que hay en las fotografías. De este modo un ordenador puede determinar qué colores tendría muy probablemente una imagen inicialmente en blanco y negro en comparación con otras fotografías parecidas. En base a imágenes en color que se corresponden con escenas y sujetos similares.

El algoritmo «decide» cuáles son los colores a aplicar, en qué partes de la imagen y con qué intensidad

Esta tarea es la que hace el algoritmo desarrollado que el investigador Richard Zhang y su equipo de colaboradores de la universidad de Berkeley y que ya adelantaron el pasado marzo. El método, descrito en el estudio titulado Colorful Image Colorization propone un sistema que añade colores creíbles a fotografías en blanco y negro. De forma totalmente automática, sin intervención humana. El algoritmo decide cuáles son los colores a aplicar, en qué partes de la imagen y con qué intensidad. Como referencia utiliza un millón de fotografías en color previamente analizadas y cargadas en el ordenador.

Si bien existen desarrollos previos similares que funcionan de forma parecida, Richard Zhang asegura que su método consigue resultados más realistas y creíbles. El equipo de Zhang sometió su algoritmo a una suerte de test de Turing del color en el cual un grupo de voluntarios debía elegir si una fotografía era en color de verdad o si era una fotografía coloreada: el método de Zhang logró engañar a los humanos una de cada cinco veces, un logro muy superior al de otros métodos.

Además, el algoritmo de Richard Zhang y su equipo está disponible como una aplicación web llamada Colorize Photos: basta con elegir una fotografía en blanco y negro —en blanco y negro original, como la fotografía de bodas de los abuelos, o una imagen en color convertida a blanco y negro— para comprobar en primera persona el funcionamiento del sistema de Zhang.

Facilitar al público el acceso práctico a este tipo de desarrollos, cada vez más habitual, es muy beneficioso

Facilitar al público el acceso práctico a este tipo de desarrollos, cada vez más habitual, es muy beneficioso. No solo por su utilidad aunque todavía diste de ser perfecta. También porque es una forma de materializar y de demostrar la utilidad práctica de este tipo de desarrollos principalmente teóricos que, de otro modo, corren el riesgo de quedarse en el papel. Pero, sobre todo, el uso práctico, diverso y retroalimentado de los sistemas de aprendizaje automático es el entrenamiento que más favorece el aprendizaje de las máquinas.

Un caso parecido es el de la aplicación The Roll. The Roll salió hace unos meses y ofrece al público la posibilidad de analizar y de etiquetar automáticamente todas sus fotografías. De modo que el usuario puede encontrar sus propias fotografías, las que guarda en su ordenador y en su teléfono móvil, escribiendo palabras que las describan. Por ejemplo, "verano", "playa", "niño" — así, también en español.

La aplicación The Roll aprovecha precisamente los conocimientos adquiridos por los sistemas de EyeVision a través del servicio online EyeEm, una web en el cual los fotógrafos clasifican sus fotografías y desde el cual las distribuyen y las venden.

Este tipo de tecnología para reconocer y entender lo que hay en una imagen es aplicable a la visión artificial para máquinas, coches autónomos y robots. También para los humanos, ayudando a que personas ciegas o con deficiencia visual pueden escuchar una descripción de las imágenes publicadas por sus contactos en Facebook y participar así en la conversación, aunque ellas no las puedan ver.