Razones por las que haces bien en tener miedo a las máquinas

Los avances de esta tecnología preocupan a empresas y gobiernos. Diversos expertos abogan por su regulación

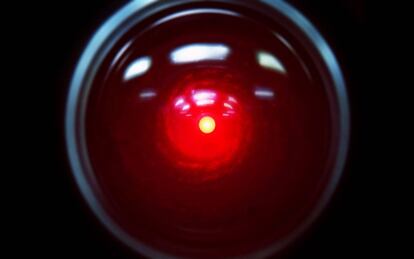

La inteligencia artificial ha atemorizado al ser humano en las salas de cine desde que esta apenas empezaba a experimentar con el procesamiento de información semántica. La voz de HALL 9000 en 2001: Una odisea del espacio o el programa Skynet de la saga Terminator han incitado a sus espectadores a reflexionar sobre el riesgo de desarrollar una tecnología que no seamos capaces de controlar. La temática de estas películas esconde una intuición catastrofista que, en mayor o menor medida, empieza a preocupar a empresas y gobiernos que esperan que la realidad no termine superando a la ficción.

Medio siglo después de la obra de Stanley Kubrick, el debate sobre los peligros de que las máquinas superen a los humanos cobra más sentido y se encuentra en su apogeo. A la batalla dialéctica entre Mark Zuckerberg y Elon Musk, fundadores de Facebook y Tesla respectivamente, se ha sumado esta semana un contendiente inesperado: el presidente ruso Vladimir Putin.

El político afirma que esta tecnología, a la que todavía le queda mucho recorrido, definirá la hegemonía mundial y alerta de los riesgos que puede acarrear a largo plazo. “La inteligencia artificial es el futuro, no sólo para Rusia, sino para toda la humanidad. Viene con oportunidades colosales, pero también amenazas que son difíciles de predecir. Quien se convierte en el líder en esta esfera se convertirá en el gobernante del mundo”, sentenció el pasado viernes ante un auditorio de estudiantes con motivo del comienzo del curso escolar en el país.

Musk aprovechó las palabras de Putin para reafirmar su postura y profundizar en su visión catastrofista de lo que podría suponer el avance descontrolado de esta tecnología. “China, Rusia y pronto todos los países se fortalecerán en ciencias de la computación. La competición por la superioridad de la inteligencia artificial a nivel nacional podría causar la tercera guerra mundial”, publicó en Twitter.

El sudafricano matizó que, en el caso de suceder, probablemente este conflicto bélico no será iniciado por grandes líderes de potencias internacionales, sino por las propias máquinas, que decidirán si es el momento de atacar basándose en sus previsiones de victoria.

La competición por la superioridad de la inteligencia artificial podría causar la tercera guerra mundial

Musk ya había tomado partido en julio, cuando animó a los gobernadores de EE UU a regular la labor de las empresas que trabajan en el perfeccionamiento de la inteligencia artificial y a crear un organismo encargado de supervisar que se cumplen las normas. Una solución de la que no era partidario Zuckerberg, que calificó como irresponsable porque, según afirmaba, la regulación solo frenaría el desarrollo de esta tecnología.

La causa del fundador de Facebook no cuenta con demasiados adeptos. Stephen Hawking se alistó anacrónicamente en las filas de Musk (más bien fue este quien le dio la razón al físico) cuando publicó que la inteligencia artificial podría ser el peor error de la humanidad. Hawking argumentaba que un sistema con esta tecnología puede llegar a decidir mejorar su propio diseño por su cuenta e imaginaba máquinas dominando mercados financieros, manipulando líderes y construyendo armas que no seríamos capaces de comprender. “Aunque el impacto a corto plazo de un sistema de inteligencia artificial depende de quien lo controla”, reconocía, “ la cuestión a largo plazo es si un sistema así puede ser controlado por seres humanos.”

En una entrevista con EL PAÍS Retina, Peter Eckersley, informático jefe en la Electronic Frontier Foundation, reconocía que, del mismo modo que algunas aplicaciones de la inteligencia artificial serán geniales, otras pueden ser fatales, e incidía en la necesidad de que tomemos las decisiones necesarias para que esta tecnología funcione como queramos que lo haga.

El astrónomo británico Sir Martin Rees coincide en la necesidad de tomar partido para prevenir consecuencias imprevistas del desarrollo tecnológico y lo expone en una charla TED de título apocalíptico: ¿Va a ser este siglo el último de nuestra existencia?

El filósofo Nick Bostrom, por su parte, comparaba la relación entre el ser humano y la inteligencia artificial con un niño jugando con una bomba. “Así es el desequilibrio entre el poder de nuestro juguete y la inmadurez de nuestra conducta”, escribió en su libro Superinteligencia: caminos, peligros y estrategias.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.