Que no te den gato por liebre… ¿o sí?

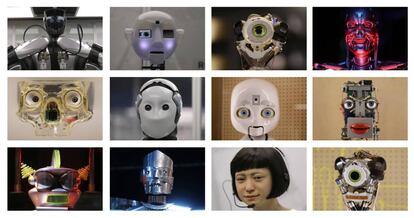

Las máquinas ya son capaces de imaginar y crear caras de personas nuevas, indistinguibles de personas reales

El escritor de ciencia ficción Philip K. Dick no iba desencaminado cuando planteaba que los androides pudieran soñar con ovejas eléctricas. Hoy en día, las máquinas ya son capaces de imaginar y crear caras de personas nuevas, indistinguibles de personas reales. Esta aplicación de la inteligencia artificial (IA) ha originado desarrollos sin precedentes en ciertos campos de la modelización matemática, llegando a interaccionar incluso con un rama aparentemente lejana de las exactas, la teoría de juegos. Repasemos cómo se ha llegado a este punto.

En los albores de la IA, los padres de esta disciplina se devanaban los sesos en dilucidar de qué manera una máquina podía aprender a distinguir, en un sentido amplio: diferenciar una transacción fraudulenta de una legítima, un correo basura de uno ordinario, o un gato de una liebre, entre muchos ejemplos.

Los modelos matemáticos subyacentes a esta apasionante tarea se han dado en llamar, en un alarde de originalidad, modelos discriminativos. Tras años de esfuerzo hemos visto cómo, en efecto, las máquinas aprenden a distinguir, siendo capaces incluso de diferenciar el rostro de un usuario del de cualquier intruso para desbloquear o no su teléfono móvil. Pero los investigadores en IA no parecen satisfechos con el logro… ¿realmente entienden las máquinas lo que están haciendo? En la línea de lo que proclamaba el físico Richard Feynmann “aquello que no puedo crear, no lo entiendo”, la investigación se ha centrado en lograr que las máquinas aprendan a crear. Crear correos spam, correos legítimos, fotos de liebres, de gatos e incluso de personas. Y como habrá adivinado el lector despierto, los modelos matemáticos que se utilizan en este ámbito se denominan modelos generativos.

Pero una cosa está clara, si la máquina es capaz de aprender a generar una foto de un gato o de una liebre, es decir, ha “entendido” la anatomía de estos mamíferos, también será capaz de distinguir un gato de un liebre. Por tanto, no nos equivocamos al pensar que la tarea de generar es intrínsecamente más compleja que la de discriminar. Uno de los grandes retos de los modelos generativos se encuentra en la dificultad de cuantificar el error: es difícil medir cómo de bien está generando la máquina. En la tarea de discriminar, cuantificar el error cometido por una máquina al distinguir gatos de liebres sería tan sencillo como ordenarle etiquetar millones de fotos como gato o liebre y contar cuántas veces se ha equivocado. Pero, ¿qué sucede si la máquina genera imágenes de gatos?, ¿cómo se mide la calidad de un gato generado?, ¿un gato bonito es más gato que uno feo?, ¿en qué momento un gato generado deja de serlo? Cuantificar el error en esta situación es, además de subjetivo, bastante complejo.

Ian Goodfellow, investigador de la Universidad de Montreal, resolvió este entuerto de una manera singular: visto que no existe criterio claro para medir cómo de buenas son las liebres generadas respecto de las reales, dejemos que esta tarea la haga otro. ¿Y quién puede cuantificar mejor la calidad de las imágenes generadas que un modelo discriminativo que haya aprendido, precisamente, a distinguir imágenes reales de imágenes generadas? La idea es la siguiente: enfrentaremos a dos máquinas, una generativa, que produce imágenes y otra discriminativa que aprende a distinguir imágenes reales de imágenes generadas. Esperamos que, cuando las generadas sean suficientemente “buenas” (suele ocurrir tras unas cuantas horas de cálculo en las cuales el generador va aprendiendo con el feedback del discriminador), la máquina generativa pueda engañar al discriminador. De esta manera, la capacidad de engañar al discriminador es una medida de lo buenas que son las imágenes generadas. Matemáticamente, el conflicto entre generador y discriminador se aborda desde la teoría de juegos: cada uno de los dos actores tiene su propio objetivo que debe ser alcanzado simultáneamente, hasta llegar a un punto donde ninguno de los dos pueda mejorar unilateralmente. Una vez más, se aprecia la sinergia entre áreas (aparentemente) diferentes de las exactas.

Si la máquina es capaz de aprender a generar una foto de un gato o de una liebre, es decir, ha “entendido” la anatomía de estos mamíferos, también será capaz de distinguir un gato de un liebre

La idea de Goodfellow se conoce como red generativa antagónica (del inglés, GAN). Tras su aparición en 2014, las GANs han calado hondo entre los investigadores en IA. Gran parte del interés que han suscitado se debe a la capacidad de las GANs de generar imágenes realistas. No obstante, no hay nada que impida aplicar la misma idea a otro tipo de datos. La estructura matemática subyacente es lo suficientemente general para poder utilizarse en campos realmente diversos como la simulación de eventos en colisionadores de partículas, la creación de piezas musicales o la generación de texto. Un ejemplo del realismo alcanzado es el algoritmo de la compañía NVIDIA, que permite generar fotos de caras especificando atributos, como el color de ojos o pelo.

Por supuesto, los grandes avances que están surgiendo en el campo acarrean consigo una fuerte polémica sobre sus posibles aplicaciones maliciosas. En una época en la que las tristemente famosas fake news han cobrado gran importancia política, la automatización de la creación de noticias falsas está a la vuelta de la esquina. El monopolio de este desarrollo se concentra en manos de grandes empresas que compiten por liderar esta revolución. ¿Quizás en aras de una sociedad mejor informada?

Victor Gallego y Roi Naveiro son investigadores predoctorales en el ICMAT. David Gordo Gómez es investigador postdoctora en el ICMAT,

Café y Teoremas es una sección dedicada a las matemáticas y al entorno en el que se crean, coordinado por el Instituto de Ciencias Matemáticas (ICMAT), en la que los investigadores y miembros del centro describen los últimos avances de esta disciplina, comparten puntos de encuentro entre las matemáticas y otras expresiones sociales y culturales y recuerdan a quienes marcaron su desarrollo y supieron transformar café en teoremas. El nombre evoca la definición del matemático húngaro Alfred Rényi: "Un matemático es una máquina que transforma café en teoremas".

Edición y coordinación:Ágata Timón (ICMAT).

Puedes seguir a MATERIA en Facebook, Twitter, Instagram o suscribirte aquí a nuestra newsletter

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.