Un grupo de académicos pide al Gobierno una moratoria en el uso del reconocimiento facial

Una carta firmada por 70 profesores y especialistas en filosofía, ética, diseño y ciencias de la computación reclama al Gobierno una investigación sobre estos métodos antes de permitirlos

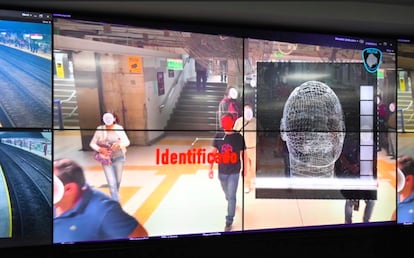

El uso de técnicas de reconocimiento facial aparece regularmente en los medios. La penúltima polémica en EEUU ha sido la exigencia de Amazon para que sus repartidores acepten con un “consentimiento biométrico” cámaras dentro de sus furgonetas y camiones: además de controlar su identidad o la posición de la cámara, el software es capaz de detectar bostezos o desatención. Ahora, en una carta firmada por 70 personalidades con distinta relación con las consecuencias de la biometría pide al gobierno que no permita su uso hasta que una comisión investigue sus problemas. Entre los firmantes están Adela Cortina, catedrática emérita de Ética y Filosofía Política de la Universidad de Valencia; Pilar Dellunde y Ramón López Mántaras, del Instituto de Investigación en IA del CSIC; Txetxu Ausín, científico titular del Instituto de Filosofía del CSIC u Ofelia Tejerina, presidenta de la Asociación de Internautas.

“La preocupación que motiva esta carta tiene que ver con los potenciales efectos perniciosos que estos sistemas pueden tener sobre el bienestar, los intereses y las necesidades y derechos fundamentales de la población española”, escriben. Su preocupación está menos vinculada con el uso policial o de seguridad del reconocimiento facial que con el análisis para entender comportamientos, reacciones o actitudes: “Los sistemas de reconocimiento y análisis de imágenes de personas (de sus caras, gestos, peinados, posturas y movimientos corporales, vestimenta, texturas y/o colores de piel) y, por extensión, los algoritmos de aprendizaje automático que los sustentan computacionalmente tienen graves problemas que han sido ampliamente documentados”, añaden.

Los autores citan varios ejemplos de este uso problemático de esta tecnología: atribuir una categoría negativa a alguien (tramposo, moroso, poco responsable) basándose en estadísticas poblaciones de un grupo; asociar posturas, gestos, peinados o prendas a comportamientos negativos o problemas de sesgos y falta de representatividad. “Debido a las graves deficiencias y riesgos que presentan estos sistemas, los posibles beneficios que quizás podrían ofrecer no compensan de ninguna manera sus potenciales efectos negativos, en especial para los grupos y colectivos que suelen sufrir injusticias y tratos discriminatorios”, escriben.

Para profundizar en este debate los promotores de la carta piden una comisión de investigación “independiente” y formada por ”científicos, juristas, expertos en ética e inteligencia artificial y miembros de la sociedad civil, especialmente de aquellos colectivos que pueden verse prima facie afectados por estos sistemas”. Los promotores son Ujué Agudo y Karlos G. Liberal, responsables de Bikolabs; David Casacuberta, profesor de Filosofía de la Universidad Autónoma de Barcelona; Ariel Guersenzvaig, profesor de la Facultad de Diseño e Ingeniería Elisava.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.