Expertos en inteligencia artificial reclaman la creación de una agencia en Europa para vigilar su desarrollo

Un grupo de científicos de alto nivel elabora un documento en el que se reclama regulación y transparencia en el desarrollo de esta tecnología

Tony Blair cree que el desafío más importante que afronta la humanidad en este momento no es el populismo ni el nacionalismo, ni tampoco la posibilidad de una nueva crisis económica, ni siquiera las consecuencias de un Brexit que considera “un error terrible”. El ex primer ministro británico cree que el principal reto al que nos enfrentamos es cómo vamos a diseñar la inteligencia artificial y cómo vamos a asumir todos los cambios que traerá consigo: “Cuando estaba en el Gobierno, la tecnología era la última de mis preocupaciones. Muchos políticos opinan lo mismo. Eso debe cambiar”.

Blair realizó estas reflexiones la pasada semana en Bruselas, durante un encuentro de alto nivel de políticos, académicos y responsables de compañías tecnológicas para debatir sobre la inteligencia artificial, organizado por el Instituto Atomium. Durante ese encuentro, los políticos y las empresas (policy makers y change makers, en palabras de Blair) debatieron cómo convertir a Europa en un polo de desarrollo de la inteligencia artificial, que ahora está concentrado en EE UU y China, y cómo abrir un debate, que en estos momentos no se está produciendo, sobre los retos y oportunidades que abre la inteligencia artificial en la salud, el transporte, la energía e incluso la justicia y el orden público. Y es en ese debate donde una veintena de científicos ha querido intervenir publicando un informe para desarrollar una “buena inteligencia artificial”, basada en decisiones éticas. Los expertos, dirigidos por el profesor de Filosofía y Ética de la Información de la Universidad de Oxford Luciano Floridi, han presentado sus conclusiones al Parlamento europeo.

En el estudio, los investigadores explican que tanto las oportunidades y los riesgos de la inteligencia artificial son “enormes”, así que realizan 20 recomendaciones con un enfoque “multidisciplinar” para tratar de desarrollar las primeras y atajar los segundos. “Estas recomendaciones constituyen el elemento final de un marco ético para el desarrollo de una buena sociedad basada en la inteligencia artificial”, dicen.

Los expertos se encuentran especialmente preocupados por identificar un proceso que pueda “remediar o compensar” cualquier problema provocado por la inteligencia artificial. Por eso, recomiendan crear una agencia europea, “similar a la Agencia del Medicamento”, que proteja “el bienestar público y supervise los productos, programas, sistemas o servicios” relacionados con la inteligencia artificial. Los expertos, que trabajan en una decena de universidades y organismos europeos, creen que este sistema debe ser similar al que ya existe con los medicamentos, garantizando así que los productos y servicios de inteligencia artificial que se vendan en Europa responden a los “estándares éticos”.

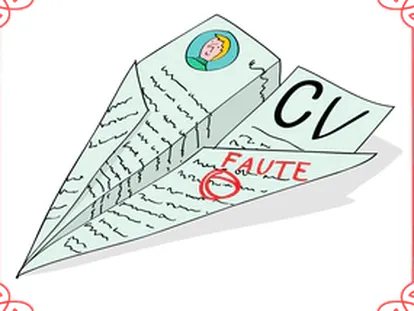

El problema es, precisamente, cuáles son esos estándares. En el informe -en el que participan expertos como Raja Chatila, del CNRS francés, Francesca Rossi, de la Universidad de Padua e IBM Research-, se especifica que los diferentes grupos de interés deberían desarrollar métricas para medir la confianza de los productos y servicios desarrollados con inteligencia artificial. Así, se podría añadir esa métrica al precio del producto o servicio, para que los consumidores valoren hasta qué punto pueden fiarse de él.

Los científicos hablan específicamente del uso de la inteligencia artificial en los tribunales. Hay ejemplos preocupantes. En Estados Unidos se utiliza el programa COMPAS desde 1998 para otorgar la libertad condicional a un convicto, ya que evalúa la posibilidad de que reincida, mediante el análisis de 137 variables. Un estudio reciente ha mostrado que falla exactamente igual que un humano. Los expertos recomiendan la creación de una especie de Defensor del pueblo de la inteligencia artificial para asegurar el derecho de los ciudadanos de reclamar cuando estos algoritmos tomen decisiones injustas o equivocadas.

La propuesta de regular la inteligencia artificial no convence a todo el mundo. “Debemos pensar en reglas, pero no debemos apresurarnos en regular”, dijo Robert Viola, director general de Redes y Tecnología de la Comisión Europea. Entre algunos expertos hay miedo de que, si Europa impone reglas a la inteligencia artificial, las compañías que la desarrollan preferirán llevarse sus productos a EE UU y China. Al encuentro celebrado en el Parlamento Europeo de Bruselas acudieron ejecutivos de compañías estadounidenses como Facebook, Microsoft o Google, muy criticadas porque sus algoritmos reflejan los prejuicios humanos y muestran sesgos machistas, clasistas o racistas: por ejemplo, si se busca “CEO” [presidente] en las imágenes Google, la inmensa mayoría de los resultados muestran a hombres blancos, de mediana edad, enfundados en trajes y corbatas. Aunque las empresas explican que trabajan muy duramente en corregir los fallos de sus algoritmos, uno de esos ejecutivos reflexiona: “¿Qué queremos, que los algoritmos reflejen la realidad o la corrijan?”. Según un estudio publicado por Ipsos con motivo del 8 de marzo pasado, solo un 3% de los CEO en las 500 mayores empresas del mundo son mujeres.

“Los datos son un reflejo de la humanidad”, reflexionaba este mismo ejecutivo, que prefiere no ser identificado debido a las estrictas reglas de las compañías de Silicon Valley para que sus trabajadores hablen con la prensa. “La inteligencia artificial no puede estar disociada de la humana que la diseña, y los humanos tienen sesgos, prejuicios y malas intenciones”. Ante este enorme desafío, todos los participantes en la cumbre reclamaron una mayor participación de filósofos y sociólogos en el debate sobre cómo estamos diseñando la inteligencia artificial y, sobre todo, de los ciudadanos, porque esa participación es, por ahora, escasa o nula. Por eso, este tema genera miedos y desconfianza. “Cuando hay cambios veloces en el mundo, los ciudadanos tienden a mostrar ansiedad porque creen que nadie ha pensado en ellos y pueden perder el control de sus vidas, y eso es lo que alimenta el populismo”, reflexionaba Tony Blair. “Debemos explicarles qué beneficios pueden obtener de la tecnología, y ser transparentes sobre los riesgos. Si volviera al Gobierno, cambiaría radicalmente mi enfoque para afrontar estos desafíos”. En cualquier caso, Europa no es la única que se ha puesto manos a la obra: esta misma semana se ha sabido que expertos de la Universidad de Harvard van a dar clases sobre inteligencia artificial a congresistas de EE UU.

Sobre la firma